자연어 처리2017

트랜스포머 — Attention Is All You Need

셀프 어텐션 기반의 새로운 아키텍처를 발표

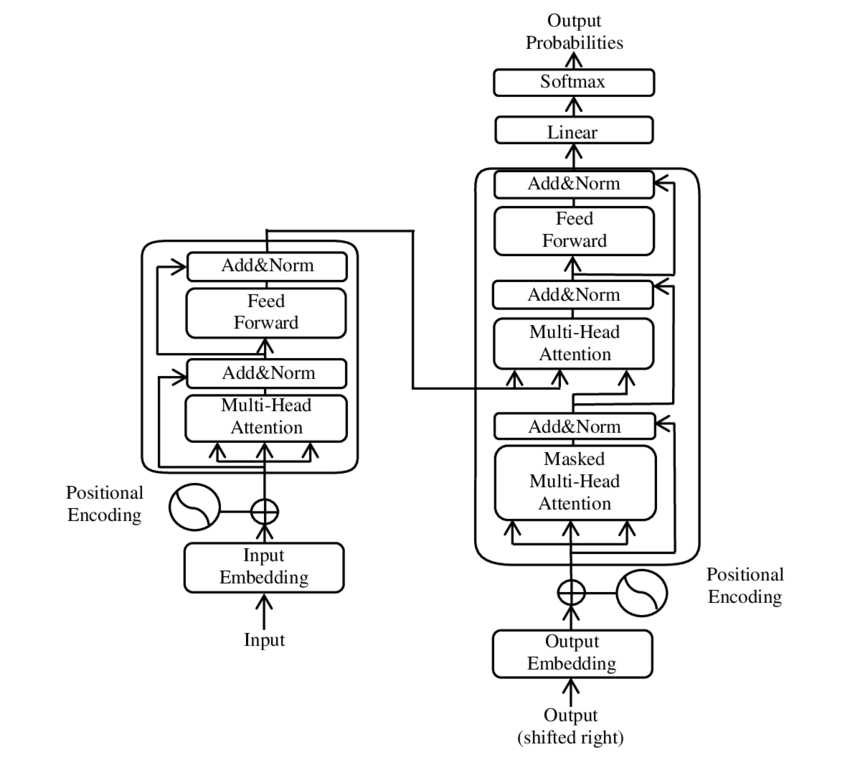

Transformer 아키텍처: 'Attention Is All You Need' 논문의 인코더-디코더 구조 (Wikimedia Commons)

트랜스포머는 RNN 없이 셀프 어텐션만으로 시퀀스를 처리합니다. 각 토큰이 다른 모든 토큰과의 관계를 동시에 계산하여 병렬 처리가 가능하고, 장거리 의존성을 잘 포착합니다.

핵심 수식

스케일드 닷-프로덕트 어텐션

포지셔널 인코딩

핵심 개념

셀프 어텐션

시퀀스 내 모든 토큰 쌍의 관련도를 동시에 계산하는 메커니즘

멀티헤드 어텐션

여러 개의 어텐션을 병렬로 수행하여 다양한 관계를 포착

포지셔널 인코딩

순서 정보가 없는 어텐션에 위치 정보를 주입하는 기법

주요 인물

아

아쉬쉬 바스와니

Transformer 논문 1저자 (Google Brain)

노

노암 샤지어(Noam Shazeer)

논문 시니어 저자, MoE 등 후속 연구

영향 & 의의

현대 AI의 근간. GPT, BERT, T5 등 거의 모든 대형 모델이 트랜스포머 기반이며, NLP를 넘어 비전(ViT), 오디오, 코드까지 확장되었습니다.